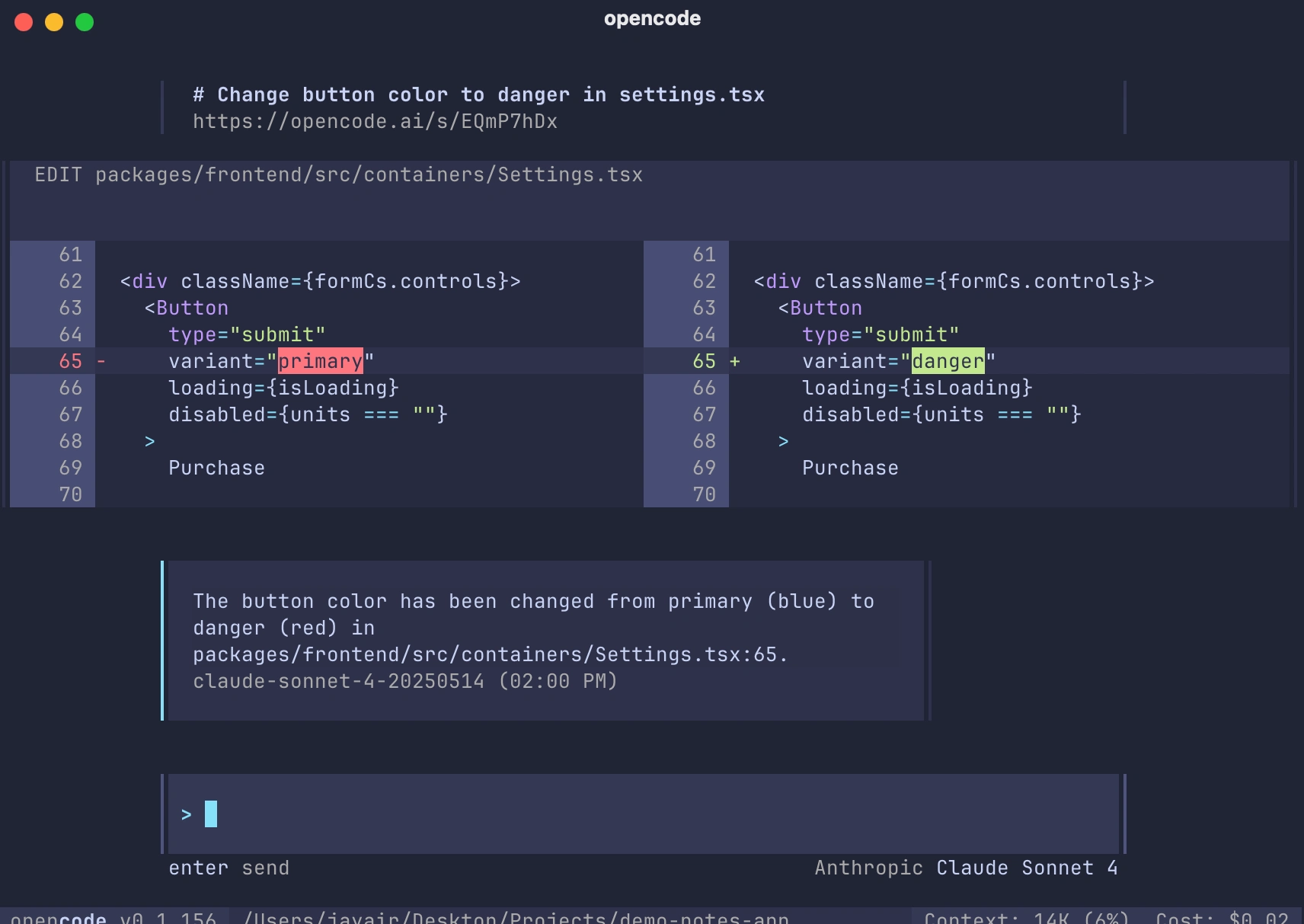

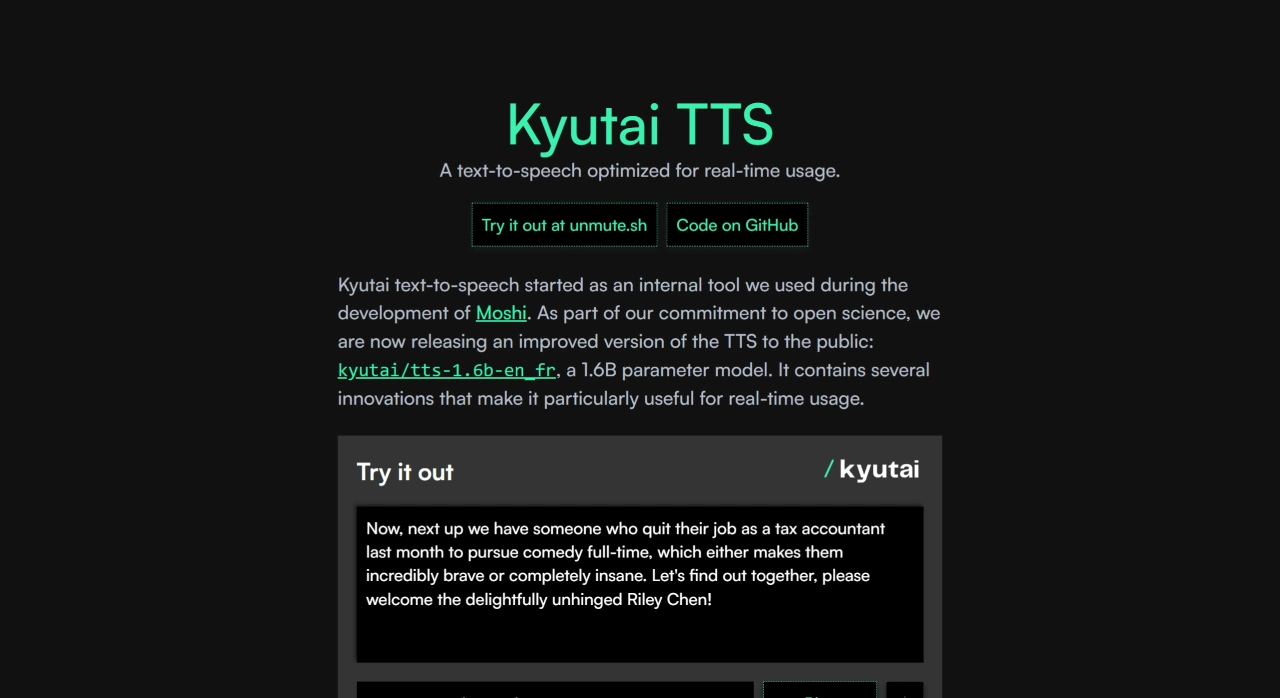

Kyutai TTS:專為實時場景設計的開源文本轉語音工具

Kyutai TTS 是法國 Kyutai Labs 開發的開源文本轉語音模型,專為實時應用設計。它有 1.6B 參數,英語和法語的字錯誤率分別是 2.82% 和 3.29%,語音生成延遲僅 220 毫秒,適合直播和語音助手等場景。其流式處理和延遲流建模技術讓文本和語音生成更高效。

技術特點:

流式處理與低延遲:Kyutai TTS 可在接收到第一個文本標記后立即生成音頻,延遲僅 220 毫秒。在 NVIDIA L40S GPU 上處理 32 個請求時,延遲約 350 毫秒。

高精度語音輸出:英語和法語的單詞錯誤率分別為 2.82% 和 3.29%,說話者相似度分別達 77.1% 和 78.7%,語音自然且接近原始樣本。

長篇內容生成:能處理長篇文章,突破了傳統 TTS 模型的 30 秒限制。

語音克隆:用戶提供 10 秒音頻樣本,模型可匹配說話者的音色、語調等。為確保合法性,Kyutai TTS 基于公開數據集提供聲音庫,不直接發布語音嵌入模型。

單詞時間戳:生成的音頻中每個單詞都有精確時間戳,便于實時字幕生成或交互式應用。

架構與訓練:

延遲流建模(DSM):模型在接收文本時可實時生成語音,支持流式文本輸入,能同時處理多個請求。

訓練數據與硬件:使用 250 萬小時公開音頻數據訓練,由 Whisper 生成轉錄文本,訓練過程使用了 32 個 H100 GPU。

應用場景:

實時交互:適用于虛擬助手、在線教育平臺和實時字幕生成。

內容創作:可用于生成播客、有聲書等長篇內容。

輔助工具:為視障人士提供高質量的文本朗讀服務。

同其它TTS對比:

與市場上其他 TTS 模型相比,Kyutai TTS 在單詞錯誤率和說話者相似度方面表現出色,尤其在實時交互場景中表現優異。

Kyutai TTS 以 CC-BY-4.0 許可證開源,源碼和權重可在 GitHub 和 Hugging Face 上找到。開發者可通過捐贈聲音數據幫助模型擴充語音風格和語言支持。

項目地址:https://kyutai.org/next/tts

提交您的產品

提交您的產品  Ai應用

Ai應用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 FastbuildAI

FastbuildAI