QVQ-Max:阿里推出的視覺推理模型,能夠理解圖片和視頻中的內(nèi)容

QVQ-Max是什么?

QVQ-Max是一款視覺推理模型,具備理解圖片與視頻內(nèi)容的能力,能依據(jù)相關(guān)信息展開分析、推理,并提供解決方案。QVQ-Max模型在多個領(lǐng)域都有出色表現(xiàn),像數(shù)學(xué)題解答、生活問題處理、編程輔助以及藝術(shù)創(chuàng)作等方面。

設(shè)計(jì)初衷

傳統(tǒng)ai模型大多依靠文字輸入,然而現(xiàn)實(shí)里很多信息是以圖片、圖表或者視頻形式呈現(xiàn)的。QVQ-Max旨在打造一個既善于捕捉視覺信息,又具備快速分析能力的助手,助力用戶解決各類實(shí)際問題。

QVQ-Max核心能力

細(xì)致觀察:QVQ-Max 能快速識別圖片中的關(guān)鍵元素,無論是復(fù)雜的圖表還是日常照片,它都能捕捉到細(xì)節(jié)。

深入推理:模型不僅識別內(nèi)容,還能結(jié)合背景知識進(jìn)行推理。例如,它可以解析幾何題中的圖形并推導(dǎo)出答案。

靈活應(yīng)用:除了分析和推理,QVQ-Max 還可以用于創(chuàng)作,比如設(shè)計(jì)插畫、生成短視頻腳本,甚至根據(jù)用戶需求創(chuàng)作角色扮演內(nèi)容。

QVQ-Max應(yīng)用場景

職場應(yīng)用:輔助完成數(shù)據(jù)分析、信息整理以及編程等工作。

學(xué)習(xí)輔助:助力解答數(shù)學(xué)、物理等學(xué)科難題,特別是配有圖表的題目。

生活協(xié)助:依據(jù)衣柜照片提供穿搭建議,或者根據(jù)食譜圖片指導(dǎo)烹飪操作。

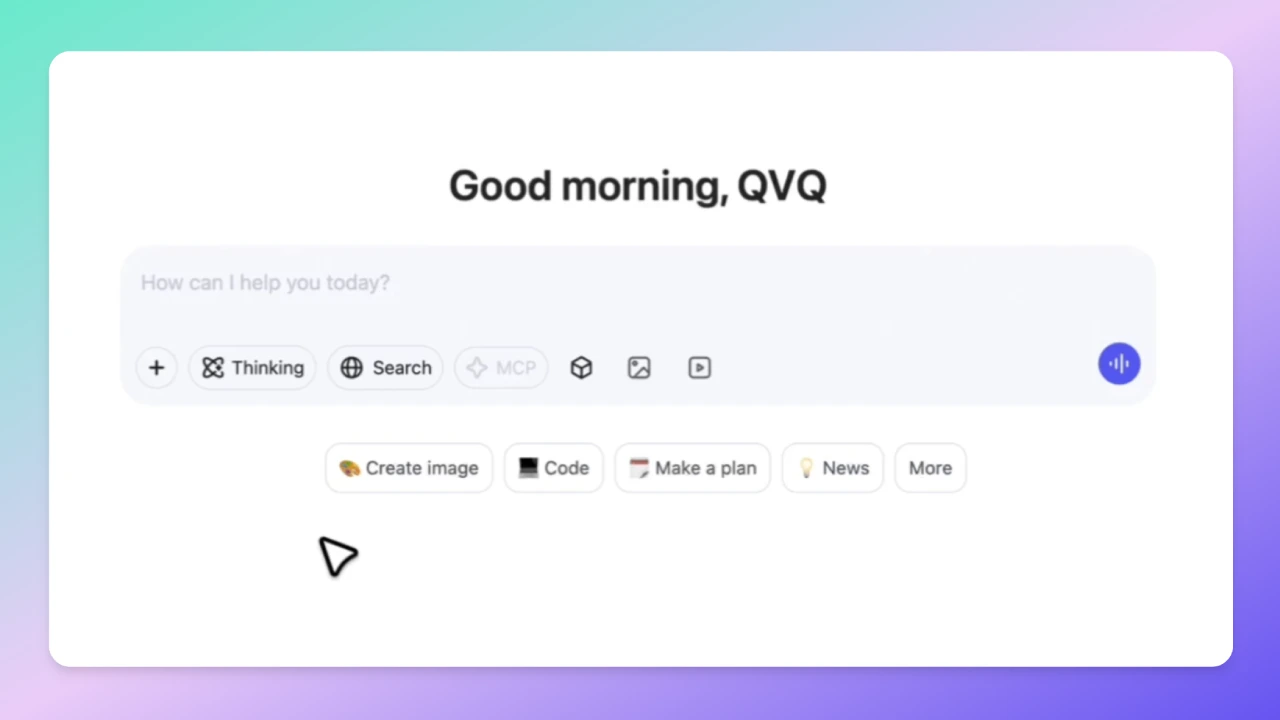

QVQ-Max的使用教程

1、進(jìn)入https://chat.qwen.ai/

2、選擇QWQ-32B模型

3、點(diǎn)輸入框的“+”號上傳圖片或視頻。

4、提問圖片的內(nèi)容。

未來發(fā)展方向

提升觀察能力:借助視覺內(nèi)容校驗(yàn)技術(shù)(如grounding),增強(qiáng)識別精準(zhǔn)度。

強(qiáng)化任務(wù)處理能力:發(fā)展視覺Agent,提高處理多步驟及復(fù)雜任務(wù)的能力,例如操作手機(jī)、電腦或玩游戲等。

優(yōu)化交互體驗(yàn):拓展交互模態(tài),涵蓋工具校驗(yàn)以及視覺生成等方面。

QVQ-Max作為一款視覺推理模型,潛力巨大。它不僅能識別圖片內(nèi)容,還能結(jié)合信息進(jìn)行分析推理,甚至完成一些創(chuàng)造性任務(wù)。盡管目前僅是第一版,但已彰顯出很大潛力,未來有望成為實(shí)用的視覺Agent,為用戶解決實(shí)際問題提供有力支持 。

詳細(xì)介紹:https://qwenlm.github.io/zh/blog/qvq-max-preview/

使用地址:https://chat.qwen.ai/

提交您的產(chǎn)品

提交您的產(chǎn)品  Ai應(yīng)用

Ai應(yīng)用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 開源AI應(yīng)用平臺

開源AI應(yīng)用平臺