DeepSeek Coder

DeepSeek Coder簡介

DeepSeek Coder是由中國人工智能公司深度求索(DeepSeek)推出的開源代碼生成大模型系列,通過深度學習技術提升代碼生成和理解能力,提升開發者的編程效率,并在多項基準測試中達到或超越主流閉源模型的性能。

一、模型架構與核心技術

混合專家架構(MoE)

DeepSeek Coder V2采用MoE架構,總參數達236B,激活參數21B,通過動態選擇專家網絡提升任務適配性。其訓練數據覆蓋338種編程語言(從V1的86種擴展而來),并支持128K上下文窗口,可處理復雜代碼倉庫和長文本任務。

創新訓練方法

Fill-In-Middle(FIM):通過隨機分割代碼為前綴(Prefix)、中間(Middle)和后綴(Suffix),訓練模型填補中間缺失部分,增強代碼補全能力。

Repo-Level預訓練:基于代碼倉庫的依賴關系構建數據集,利用拓撲排序處理跨文件依賴,提升項目級代碼生成能力。

強化學習優化

采用GRPO(Group Relative Policy Optimization)算法對齊人類偏好,結合編譯器反饋和測試用例優化代碼正確性。

二、性能表現與基準測試

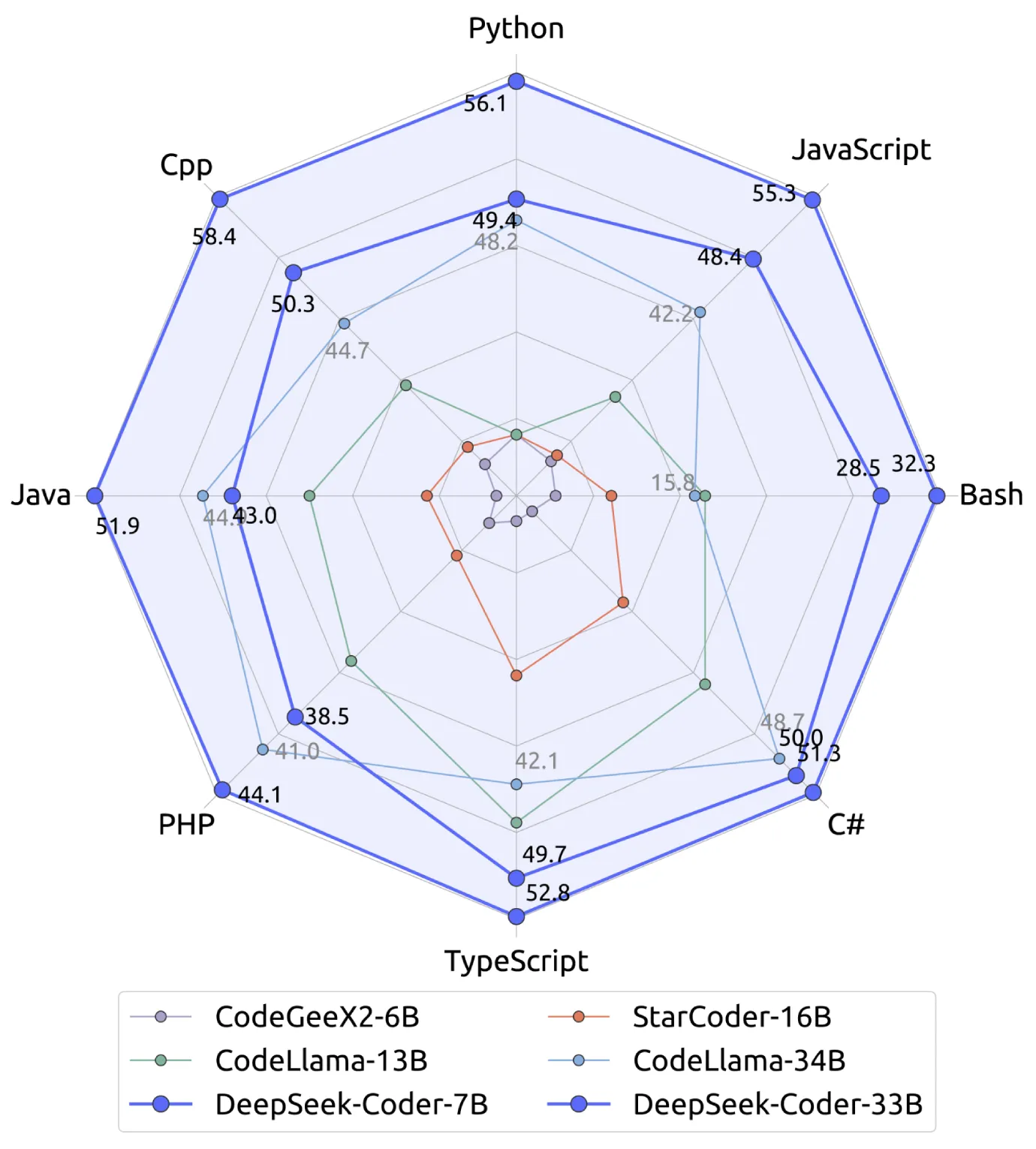

代碼生成能力

在HumanEval基準測試中,DeepSeek Coder V2的準確率達90.2%,超過GPT-4-Turbo和Claude 3 Opus8。

在SWEBench(復雜代碼任務測試)中,首次實現開源模型得分超過10%。

支持多語言生成,覆蓋Python、Java、Rust等338種語言,生成速度比GPT-4快20%。

數學與推理能力

在MATH、aiME等數學競賽級基準測試中,性能與GPT-4o、Gemini 1.5 Pro相當。

通過鏈式推理(Chain-of-Thought,COT)顯著提升復雜問題解決能力。

通用語言處理

在MMLU(多任務語言理解)測試中得分79.2%,保持與通用模型(如DeepSeek-V2)相當的通用能力。

三、開發者生態與應用場景

開源與低成本

模型、代碼及技術報告完全開源(MIT協議),支持免費商用和二次開發。

API定價極具競爭力,輸入成本僅0.27美元/百萬tokens(緩存命中時低至0.07美元),遠低于GPT-4的18美元。

集成與部署

提供Hugging Face預訓練模型和本地私有化部署方案,支持單機880G顯存部署或單卡40G輕量版(V2-Lite)。

集成開發工具鏈(如vLLM框架),優化稀疏注意力機制,降低內存占用并提升推理速度。

應用案例

自動化代碼審查:識別代碼漏洞并提出優化建議,加速開發周期。

API構建:自動生成RESTful服務、GraphQL查詢等,減少模板代碼編寫。

機器學習項目:生成數據管道和算法代碼,支持端到端AI開發。

DeepSeek Coder 可以廣泛應用于軟件開發、數據分析、自動化測試等領域。它不僅能夠生成代碼,還能回答與編程相關的問題,幫助開發者提高工作效率。

DeepSeek Coder通過技術創新(如MoE架構、FIM訓練)和開源生態,重新定義了代碼生成模型的性能邊界。其高性價比、多語言支持和項目級代碼處理能力,使其成為開發者提升效率的核心工具,同時推動全球AI開源社區的協作與進步。隨著后續多模態和更大規模模型的推出,DeepSeek或將成為AGI時代代碼生成領域的標桿。

Github代碼庫:https://github.com/deepseek-ai/DeepSeek-Coder

提交您的產品

提交您的產品  Ai應用

Ai應用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 FastbuildAI

FastbuildAI