Insert Anything:開(kāi)源圖片編輯框架,可以換臉、換服裝等功能

Insert Anything 介紹

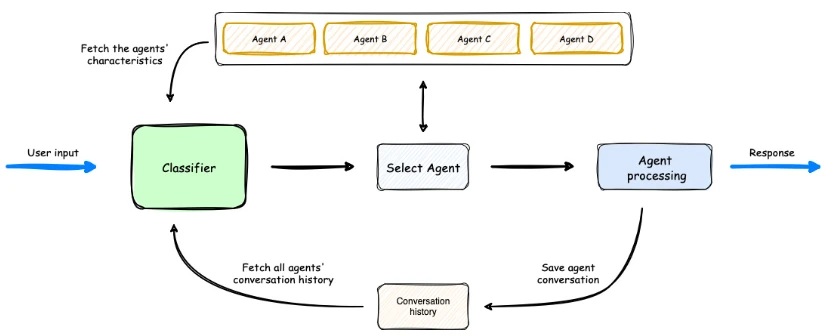

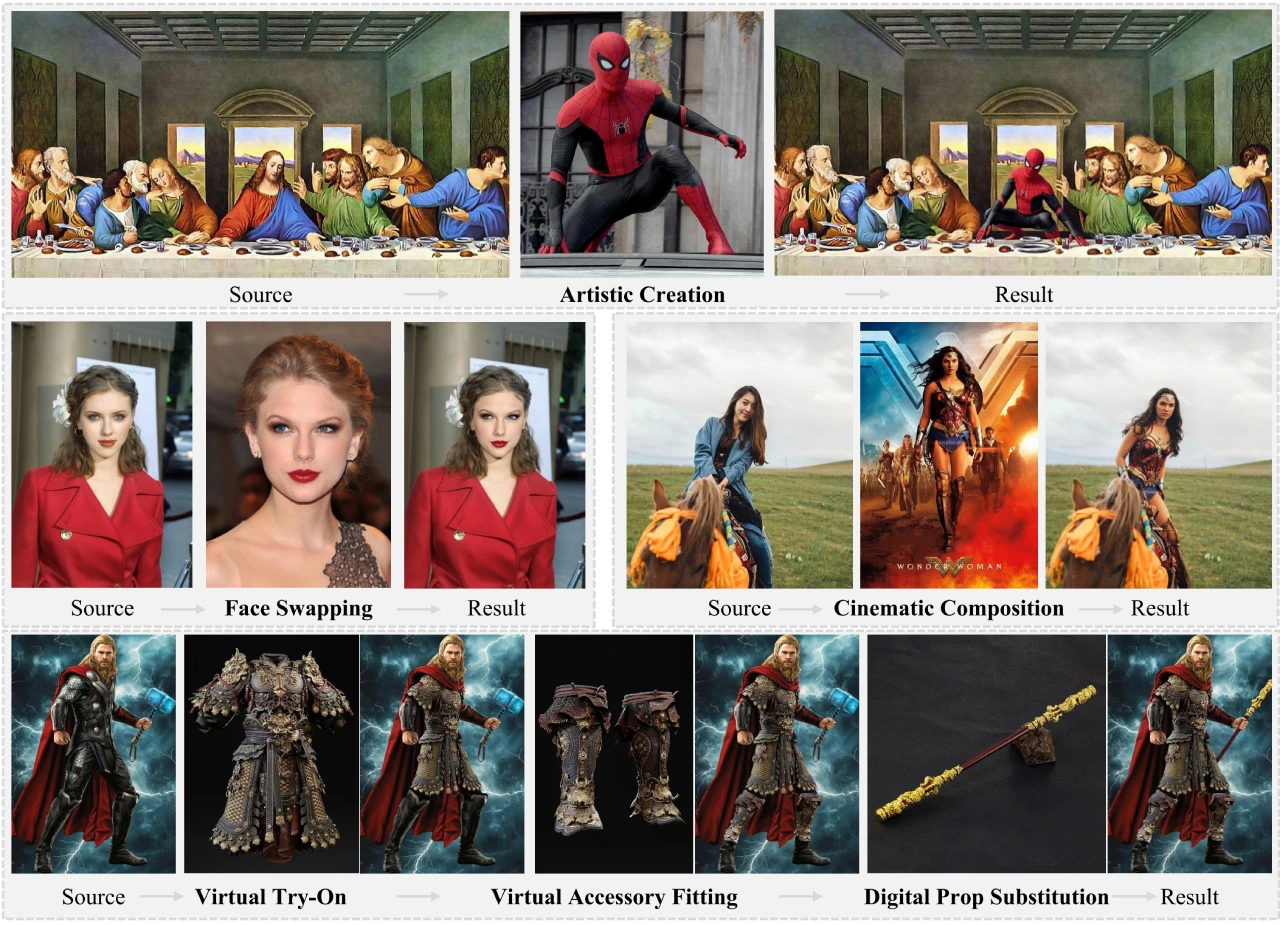

Insert Anything 是一個(gè)由浙江大學(xué)、哈佛大學(xué)和南洋理工大學(xué)聯(lián)合提出的統(tǒng)一圖像插入框架,可以將參考圖像中的對(duì)象無(wú)縫集成到目標(biāo)場(chǎng)景中,支持多種實(shí)際應(yīng)用場(chǎng)景,如藝術(shù)創(chuàng)作、逼真的臉部交換、電影場(chǎng)景構(gòu)圖、虛擬服裝試穿、配飾定制和數(shù)字道具更換。

Insert Anything技術(shù)原理

1. AnyInsertion 數(shù)據(jù)集

規(guī)模與內(nèi)容:該框架基于一個(gè)包含 12 萬(wàn)個(gè)提示-圖像對(duì)的 AnyInsertion 數(shù)據(jù)集,涵蓋了人物、物體和服裝插入等多種任務(wù)。

多控制模式:數(shù)據(jù)集支持兩種控制模式,即掩碼提示(58K 對(duì))和文本提示(101K 對(duì)),為模型提供了豐富的訓(xùn)練樣本。

2. Diffusion Transformer (DiT)

多模態(tài)注意力機(jī)制:Insert Anything 利用 DiT 的多模態(tài)注意力機(jī)制,支持掩碼和文本引導(dǎo)的編輯。該機(jī)制通過(guò)圖像分支和文本分支分別處理視覺(jué)輸入和文本描述,然后通過(guò)多模態(tài)注意力融合這些信息。

圖像分支:處理參考圖像、源圖像和掩碼,提取視覺(jué)特征并與噪聲拼接。

文本分支:編碼文本描述以提供語(yǔ)義引導(dǎo)。

3. 上下文編輯機(jī)制

雙聯(lián)畫與三聯(lián)畫提示策略:

掩碼提示雙聯(lián)畫:左側(cè)為參考圖像,右側(cè)為帶有掩碼的目標(biāo)圖像。

文本提示三聯(lián)畫:左側(cè)為參考圖像,中間為源圖像,右側(cè)為文本生成的結(jié)果。

功能:該機(jī)制將參考圖像視為上下文信息,通過(guò)隱式交互確保插入元素與目標(biāo)場(chǎng)景的視覺(jué)一致性,同時(shí)保留其獨(dú)特特征。

優(yōu)勢(shì)

通用性:?jiǎn)我荒P湍軌蛱幚矶喾N插入任務(wù),避免了為每個(gè)任務(wù)單獨(dú)訓(xùn)練模型。

靈活性:支持掩碼和文本兩種控制模式,滿足不同用戶的編輯需求。

視覺(jué)一致性:通過(guò)上下文編輯機(jī)制,確保插入元素與目標(biāo)場(chǎng)景自然融合。

Insert Anything應(yīng)用場(chǎng)景

藝術(shù)創(chuàng)作:將藝術(shù)元素?zé)o縫插入到不同的背景中。

商業(yè)廣告:將產(chǎn)品圖像插入到廣告場(chǎng)景中。

流行文化創(chuàng)作:將流行文化元素插入到相關(guān)場(chǎng)景中。

項(xiàng)目鏈接

項(xiàng)目主頁(yè):https://song-wensong.github.io/insert-anything/

論文:https://arxiv.org/abs/2504.15009

Github:https://github.com/song-wensong/insert-anything

提交您的產(chǎn)品

提交您的產(chǎn)品  Ai應(yīng)用

Ai應(yīng)用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 開(kāi)源AI應(yīng)用平臺(tái)

開(kāi)源AI應(yīng)用平臺(tái)