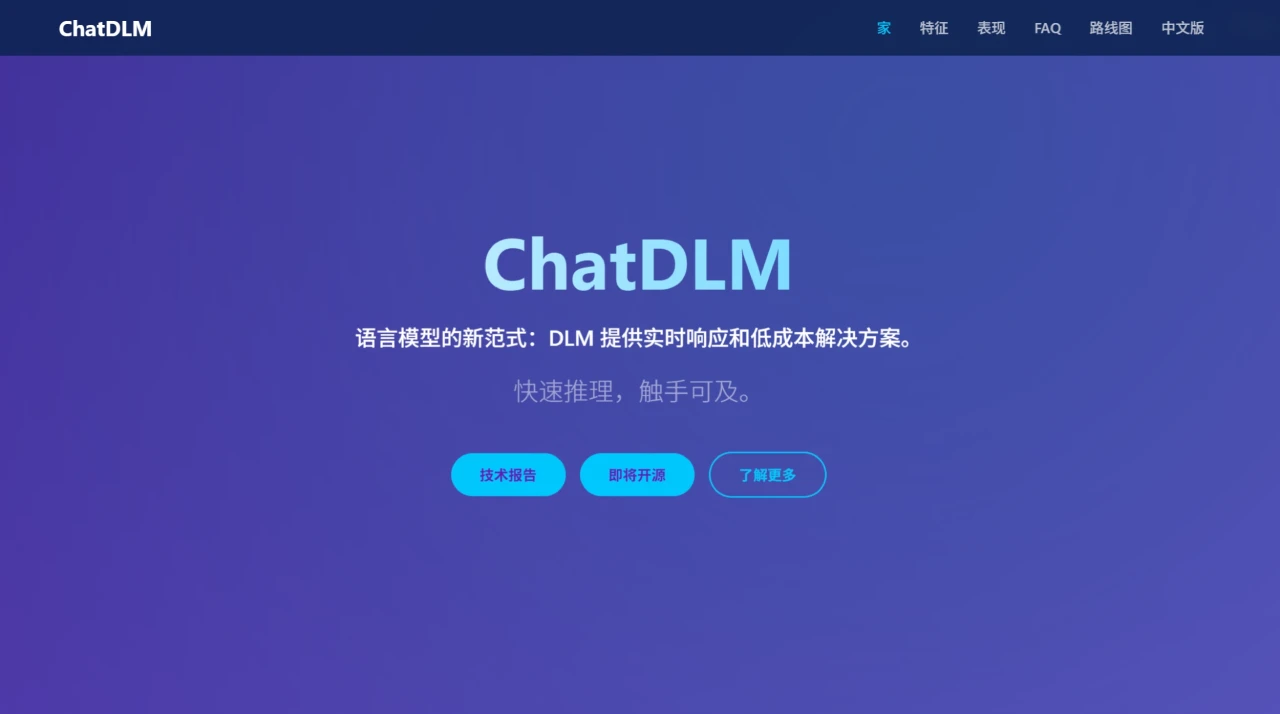

ChatDLM:全球最快的擴(kuò)散語言模型

ChatDLM是什么?

ChatDLM是Qafind Labs開發(fā)的下一代基于擴(kuò)散的語言模型,具有超快的速度生成(每秒超 2800 個 token)、可控生成、局部修復(fù)、多約束任務(wù)處理、卓越翻譯、資源高效(運營成本降低 30%)等特點,在多項任務(wù)上性能優(yōu)于其他模型,未來還將向多模態(tài)、更精準(zhǔn)的可控生成方向發(fā)展,并且重新思考語言模型的工作方式。

ChatDLM模型特點

超快速生成:每秒可生成超 2800 個 token,能實現(xiàn)實時響應(yīng),讓對話流暢自然。

可控生成:可對文本生成進(jìn)行精準(zhǔn)控制,滿足特定需求,定制輸出內(nèi)容。

局部修復(fù):能無縫編輯生成內(nèi)容的特定部分,無需重新生成全部文本。

多約束任務(wù)處理:可同時處理具有多種要求的復(fù)雜任務(wù),給出精確解決方案。

卓越翻譯:在翻譯任務(wù)中表現(xiàn)出色,能保留語言間的上下文和細(xì)微差別。

資源高效:優(yōu)化的架構(gòu)降低了計算需求,使運營成本降低 30%,可應(yīng)用于 10 多個專業(yè)場景。

ChatDLM性能優(yōu)勢

ChatDLM在可控生成、局部修復(fù)、多約束任務(wù)、數(shù)字倒計時、行程規(guī)劃、數(shù)獨求解、翻譯等場景中表現(xiàn)出顯著優(yōu)勢。與傳統(tǒng)語言模型相比,ChatDLM在這些關(guān)鍵領(lǐng)域的性能更優(yōu)。

技術(shù)路線圖

多模態(tài)擴(kuò)展:將ChatDLM的能力擴(kuò)展到多種模態(tài),包括文本、圖像,甚至音頻。

進(jìn)一步可控生成:推進(jìn)精確文本生成能力,實現(xiàn)更精細(xì)的風(fēng)格、語調(diào)、長度和內(nèi)容控制。

重新構(gòu)想語言模型:從根本上重新思考語言模型的工作方式,突破現(xiàn)有范式,創(chuàng)造真正的下一代人工智能系統(tǒng)。

ChatDLM常見問題解答

什么是DLM?

答:DLM 是融合擴(kuò)散過程和自回歸解碼的大語言模型。它將原本用于圖像和視頻合成的擴(kuò)散技術(shù)應(yīng)用于文本,通過正向擴(kuò)散和反向噪聲初始化,逐步優(yōu)化輸出為高質(zhì)量內(nèi)容。

DLM 有什么優(yōu)勢?

答:在可控生成、局部修復(fù)(部分重寫)、多約束任務(wù)、數(shù)字倒計時、行程規(guī)劃、數(shù)獨求解、翻譯等場景優(yōu)勢顯著。

為什么 DLM 實用?

答:DLM 通過塊級并行擴(kuò)散生成和高效自回歸知識提取相結(jié)合,不僅能快速準(zhǔn)確地生成文本,還將生成質(zhì)量和速度提升到了可投入實際應(yīng)用的新高度,擁有 131,072-token 的上下文窗口,一次可處理近 100,000 個英語單詞。

ChatDLM 在多約束任務(wù)處理方面具體有哪些優(yōu)勢?

答:ChatDLM 可同時處理具有多種要求的復(fù)雜任務(wù),并給出精確解決方案。相比其他模型,它在處理像行程規(guī)劃、數(shù)獨求解這類涉及多約束條件的任務(wù)時,表現(xiàn)更出色,能綜合考慮各種因素,得出更優(yōu)結(jié)果。

與其他模型相比,ChatDLM 的超快速生成能力對用戶體驗有哪些直接影響?

答:ChatDLM 每秒超 2800 個 token 的生成速度,能實現(xiàn)實時響應(yīng),讓對話更加流暢自然。這意味著用戶在與模型交互時,無需長時間等待回復(fù),交流過程更加順暢,大大提升了使用體驗。

ChatDLM 未來發(fā)展規(guī)劃中的多模態(tài)拓展,可能會面臨哪些技術(shù)挑戰(zhàn)?

答:要實現(xiàn)多模態(tài)拓展,ChatDLM 可能面臨如何有效融合不同模態(tài)數(shù)據(jù)的挑戰(zhàn),如文本、圖像和音頻的數(shù)據(jù)結(jié)構(gòu)和特征差異大,需要找到合適的方法將它們整合在一起進(jìn)行處理。此外,還需解決如何讓模型在不同模態(tài)之間靈活切換和協(xié)同工作,以提供更加自然和智能的交互體驗等問題。

相關(guān)鏈接

官方介紹:https://www.chatdlm.com/about/

在線內(nèi)測:https://www.chatdlm.cn/

相關(guān)文章

- 用戶登錄

提交您的產(chǎn)品

提交您的產(chǎn)品  Ai應(yīng)用

Ai應(yīng)用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 開源AI應(yīng)用平臺

開源AI應(yīng)用平臺