VideoMind:集視頻自動化生產、長視頻推理以及視頻摘要等功能于一體的視頻AI工具。

VideoMind是什么?

VideoMind 是一款集視頻ai模型自動化生產、長視頻推理以及視頻摘要等功能于一體的視頻AI工具。它基于流程化操作,自動化程度高,內置海量數據,可快速訓練高質量模型。同時,通過鏈式 LoRA 策略實現長視頻推理,精準定位并生成答案。此外,還能一鍵生成視頻摘要,幫助用戶快速提取關鍵信息,提升視頻內容處理效率。

VideoMind功能特征

功能全面:集成了從創建模型到發布模型的全部功能,包括新建模型、創建標簽、上傳數據、標注數據、訓練模型、評估校驗、發布模型等7個環節。

數據豐富:集成了高達百萬小時的標注數據,內置海量主題標簽和實體標簽。用戶創建標簽時如果成功映射內置標簽,將不再需要針對此標簽上傳數據以及標注數據。

生產高效:一方面自動化生產流程降低了技術門檻,為客戶省去了開發時間;另一方面內置的預訓練AI網絡結構和參數,讓客戶能夠快速訓練模型和迭代模型。

模型質量高:得益于百度在AI領域多年的積累,VideoMind生產的模型具備出色的模型效果,能支持企業垂類視頻及圖像內容分析需求。

部署靈活:訓練完成的模型支持部署到公有云、私有云、嵌入式設備等,之后客戶通過API的方式就可以調用。

一鍵生成摘要:可一鍵生成社交帖文的視頻摘要、翻譯和格式化。

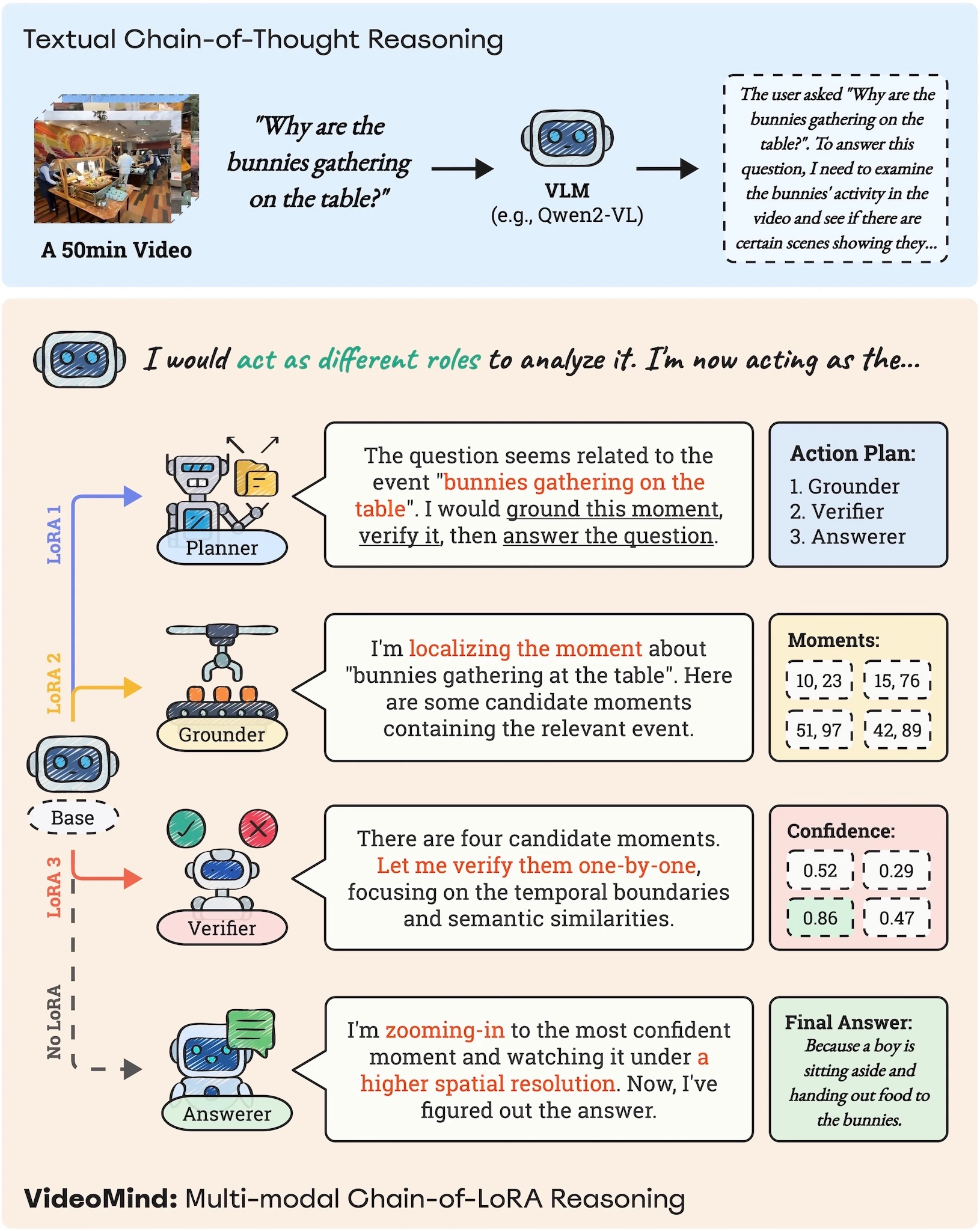

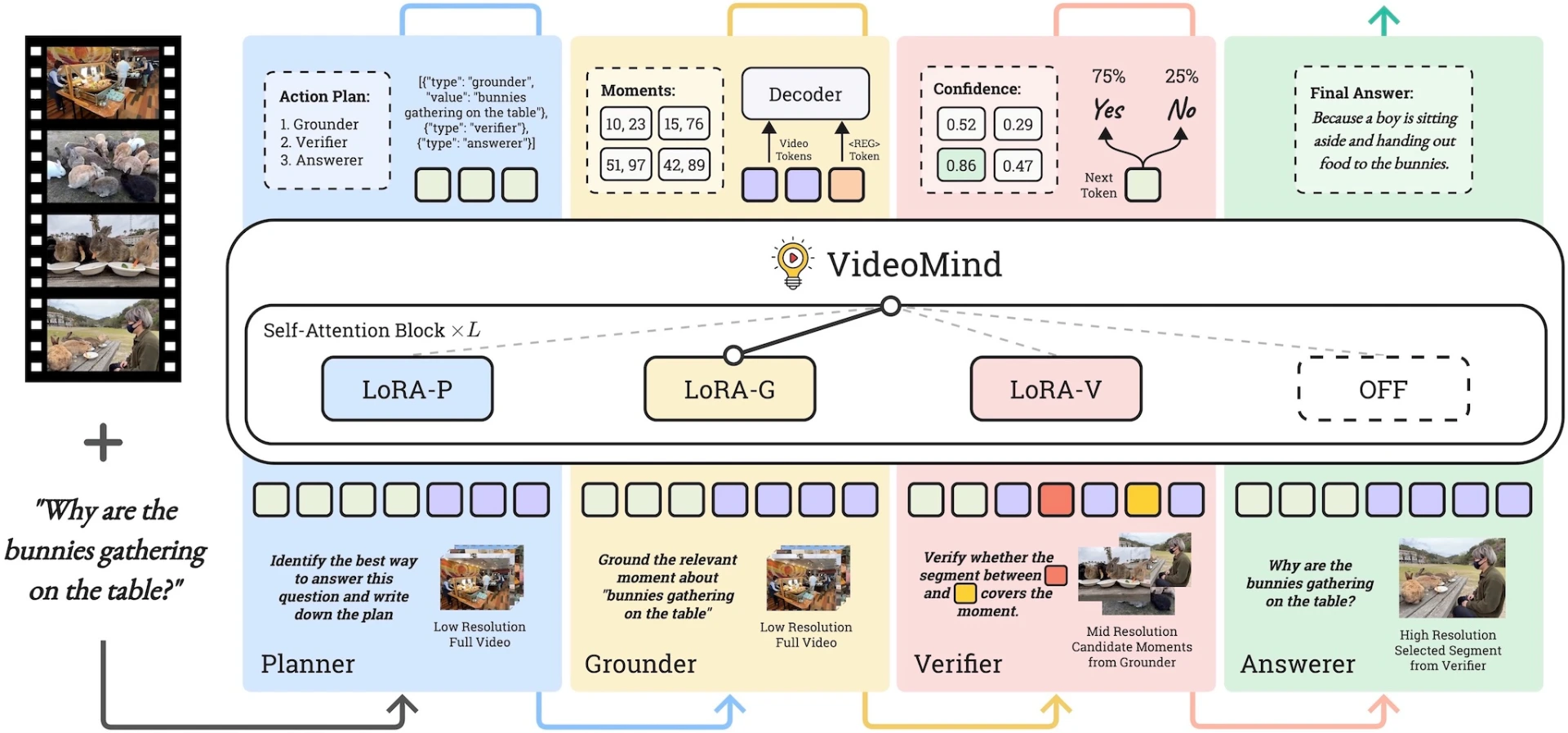

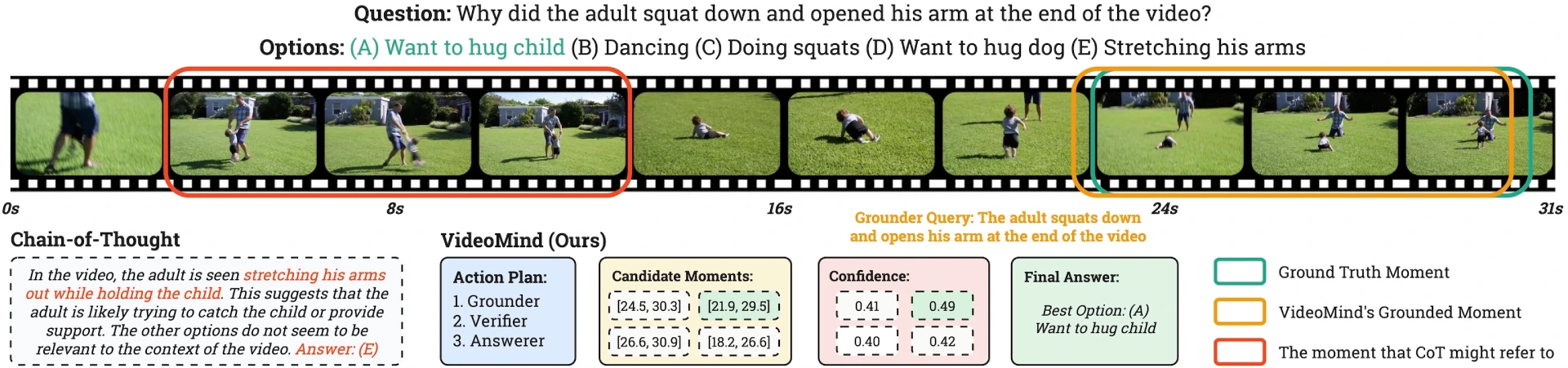

長視頻推理能力:通過基于角色的工作流(包括規劃者、定位者、驗證者和回答者)和鏈式LoRA策略,實現對長視頻的精確時間定位和推理,能夠高效地處理復雜的視頻理解任務。

快速提取關鍵信息:能夠幫助用戶快速準確地分析和總結YouTube視頻的關鍵信息,節省時間和精力。

長視頻推理的Chain-of-LoRA 代理

基于角色的工作流:定義了四種角色相互配合來實現長視頻推理,分別是planner、grounder、verifier、answerer。

規劃者(Planner):負責根據查詢動態協調其他角色的調用順序。

定位者(Grounder):負責根據文本查詢精確定位視頻中的相關時刻。

驗證者(Verifier):負責驗證定位者結果的準確性。

回答者(Answerer):負責生成最終的自然語言回答。

鏈式lora策略:以一個視覺-語言模型為基礎,在推理時動態激活角色特定的 LoRA 適配器,高效地整合上述角色。

性能出色:在多個公共基準測試中表現出色,包括細節性視頻問答任務、視頻時間定位任務、通用性視頻問答任務等。

VideoMind應用場景

教育領域:學生可以快速獲取課程視頻的重點內容,輔助學習和復習。

商業分析:企業可以對市場調研視頻進行摘要,快速獲取行業動態和競爭對手信息。

內容創作:視頻創作者可以提煉出自己視頻中的精華,制作宣傳材料或社交媒體內容。

娛樂消費:用戶在觀看長視頻時,可以快速了解視頻的主要內容,幫助決定是否觀看完整視頻。

社交媒體:在短視頻平臺,用戶可以提取視頻中的亮點,制作吸引人的短視頻內容。

相關鏈接

項目主頁:https://videomind.github.io/

Github地址:https://github.com/yeliudev/VideoMind

Demo:https://huggingface.co/spaces/yeliudev/VideoMind-2B

論文:https://arxiv.org/abs/2503.13444

提交您的產品

提交您的產品  Ai應用

Ai應用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 開源AI應用平臺

開源AI應用平臺