Open-Sora 2.0:潞晨科技推出的一款開(kāi)源SOTA視頻生成模型

Open-Sora 2.0是什么?

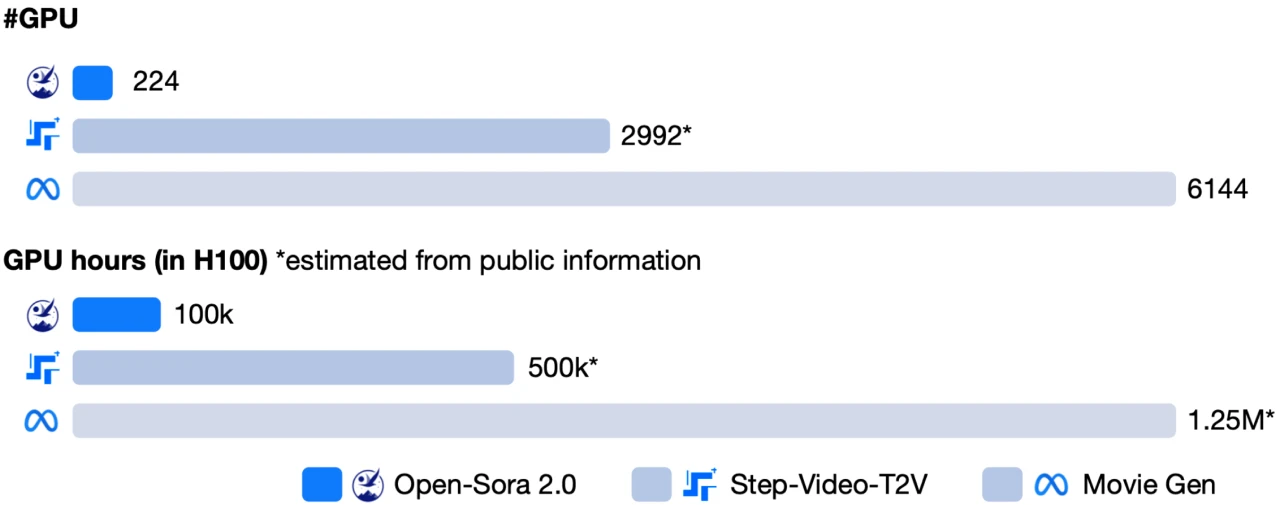

Open-Sora 2.0是由潞晨科技推出的一款全新開(kāi)源的SOTA視頻生成ai模型。它僅用20萬(wàn)美元(224張GPU)就成功訓(xùn)練出商業(yè)級(jí)11B參數(shù)視頻生成大模型,實(shí)現(xiàn)接近 SOTA(最優(yōu))質(zhì)量,但性能直追HunyuanVideo和 階躍星程30B參數(shù)的Step-Video,接近 OpenAI Sora!Open-Sora 2.0具備高效訓(xùn)練和推理優(yōu)化,能夠快速生成 720p 分辨率的流暢視頻,適用于創(chuàng)意視頻制作、社交媒體內(nèi)容生成等領(lǐng)域。

Open-Sora 2.0功能特征

高質(zhì)量視頻生成:支持720p高分辨率和24FPS流暢視頻生成,能夠生成細(xì)節(jié)豐富、場(chǎng)景切換自然的視頻。

動(dòng)作幅度可控:可根據(jù)需求設(shè)定運(yùn)動(dòng)幅度,以更好地展現(xiàn)人物或場(chǎng)景的細(xì)膩動(dòng)作。

高性能與低成本:

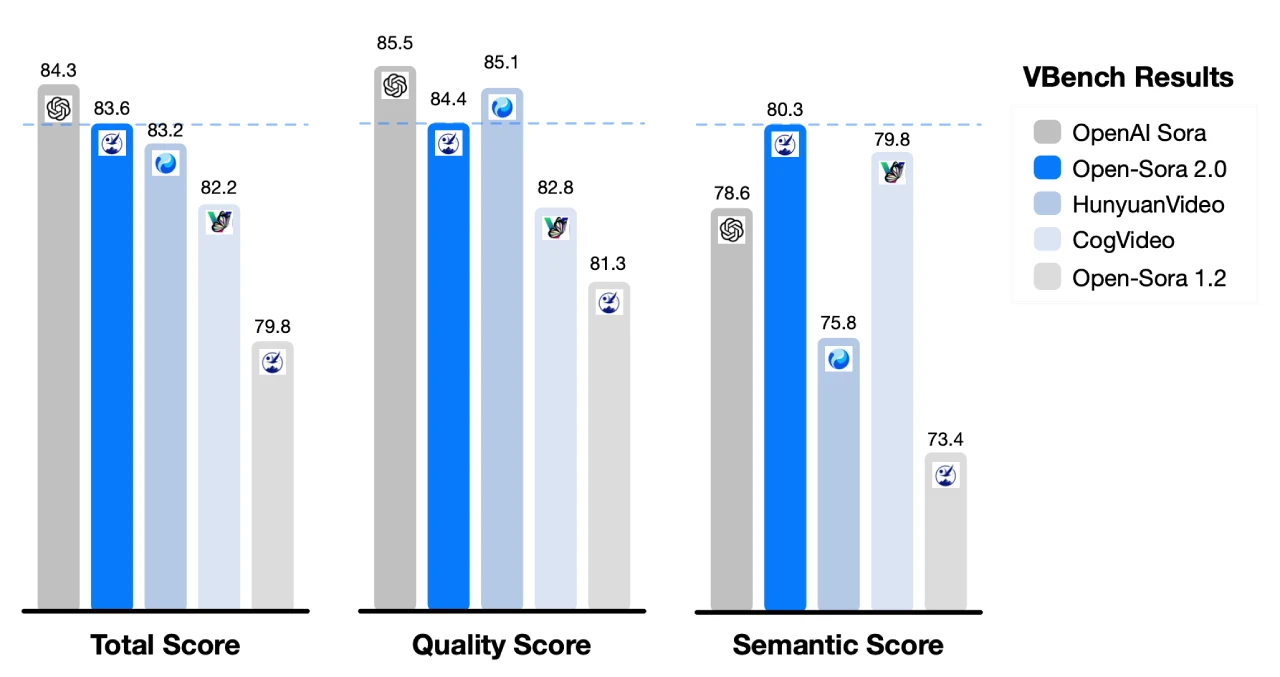

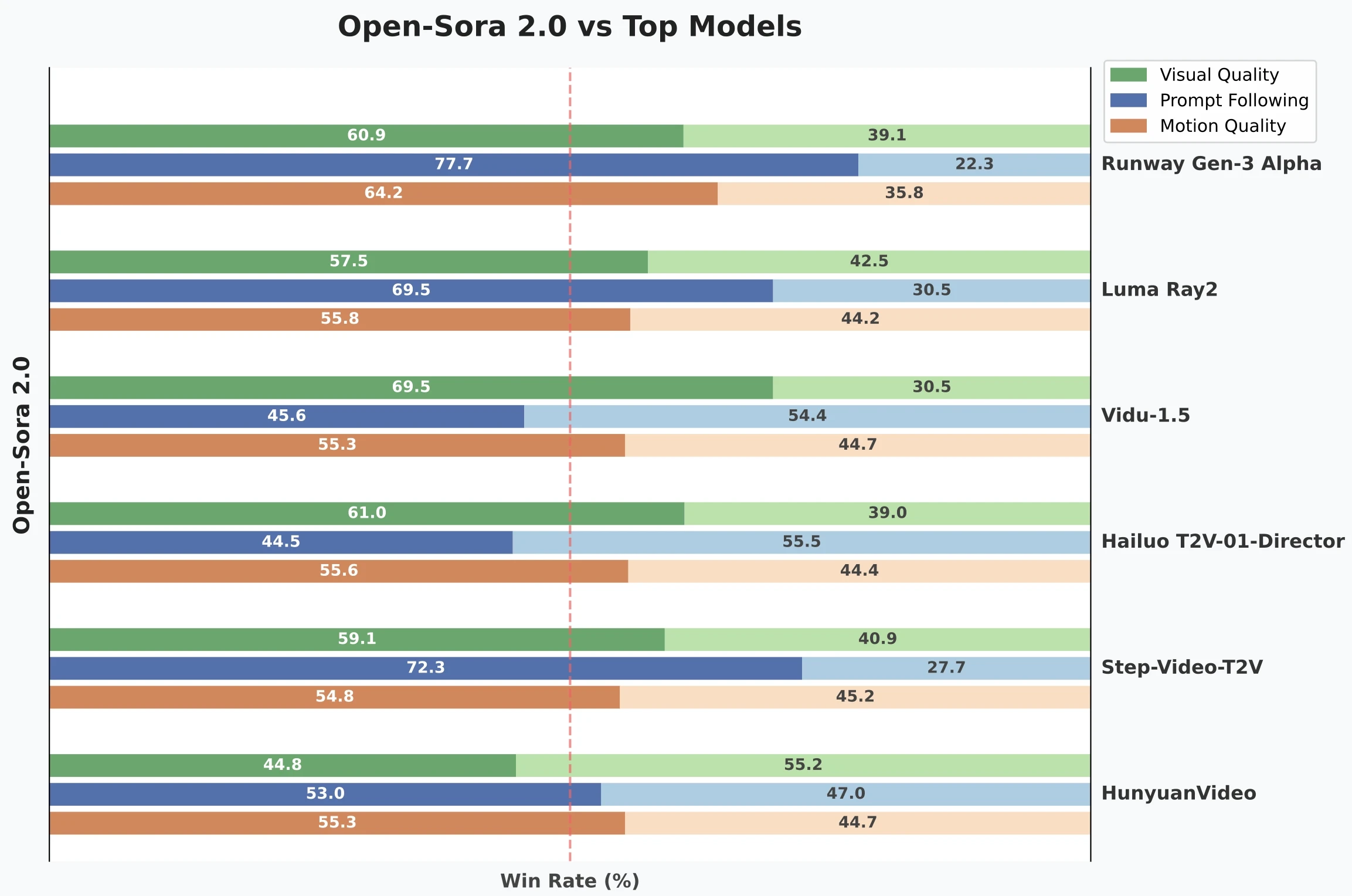

Open-Sora 2.0 采用 11B 參數(shù)規(guī)模,性能媲美甚至超越主流閉源大模型(如 HunyuanVideo 和 30B 參數(shù)的階躍星程),在 VBench 和人工偏好測(cè)試中表現(xiàn)卓越。

訓(xùn)練成本大幅降低,僅用 20 萬(wàn)美元(224 張 GPU)即可完成訓(xùn)練,相比傳統(tǒng)高性能視頻生成模型,成本降低了 5-10 倍。,媲美 OpenAI Sora。

多種生成方式:

高效訓(xùn)練與優(yōu)化:

采用多階段、多層次的數(shù)據(jù)篩選機(jī)制,確保高質(zhì)量數(shù)據(jù)輸入,提升訓(xùn)練效率。

優(yōu)先在低分辨率下訓(xùn)練,學(xué)習(xí)關(guān)鍵動(dòng)態(tài)特征,逐步提升分辨率,大幅降低計(jì)算開(kāi)銷。

優(yōu)先訓(xùn)練圖生視頻任務(wù),用圖像特征引導(dǎo)視頻生成,加速模型收斂。

結(jié)合ColossalAI和系統(tǒng)級(jí)優(yōu)化,提升計(jì)算資源利用率。

引入高壓縮比視頻自編碼器,將推理時(shí)間縮短至單卡3分鐘以內(nèi),推理速度提高了10倍。

強(qiáng)大的模型架構(gòu):

基于3D自編碼器、3D全注意力機(jī)制和MMDiT架構(gòu),顯著提升訓(xùn)練效率和推理速度。

通過(guò)多桶訓(xùn)練機(jī)制,實(shí)現(xiàn)對(duì)不同視頻長(zhǎng)度和分辨率的同時(shí)訓(xùn)練。

Open-Sora 2.0技術(shù)突破

模型架構(gòu):采用3D全注意力機(jī)制和MMDiT架構(gòu),增強(qiáng)時(shí)空特征建模能力;基于擴(kuò)散Transformer(DiT)擴(kuò)展,引入時(shí)間注意力層,實(shí)現(xiàn)視頻序列的動(dòng)態(tài)生成。

高效訓(xùn)練策略:通過(guò)多級(jí)過(guò)濾機(jī)制確保高質(zhì)量訓(xùn)練數(shù)據(jù)輸入,優(yōu)先學(xué)習(xí)運(yùn)動(dòng)特征,再通過(guò)圖生視頻(T2I2V)提升畫(huà)質(zhì),節(jié)省40倍計(jì)算資源。

推理加速革命:采用高壓縮自編碼器(4×32×32壓縮比),將768px視頻生成時(shí)間從30分鐘縮短至3分鐘,速度提升10倍。

Open-Sora 2.0應(yīng)用場(chǎng)景

創(chuàng)意視頻制作:可用于制作科幻短片、動(dòng)畫(huà)短片等,滿足創(chuàng)意視頻制作和內(nèi)容生成的需求。

社交媒體內(nèi)容生成:能夠生成適合社交媒體分享的高質(zhì)量視頻內(nèi)容。

游戲視頻制作:為游戲視頻的制作提供便利。

GitHub開(kāi)源倉(cāng)庫(kù):https://github.com/hpcaitech/Open-Sora

技術(shù)報(bào)告:https://github.com/hpcaitech/Open-Sora-Demo/blob/main/paper/Open_Sora_2_tech_report.pdf

提交您的產(chǎn)品

提交您的產(chǎn)品  Ai應(yīng)用

Ai應(yīng)用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 FastbuildAI

FastbuildAI