FireRedASR

FireRedASR簡介

FireRedASR 是由小紅書 FireRed 團隊于2025年2月9日發(fā)布并開源的基于大模型的語音識別模型,它在中文普通話語音識別領(lǐng)域取得了新的SOTA(字錯誤率CER 3.05%),并支持方言、英語及歌詞識別。

FireRedASR的主要功能:

高精度語音識別:FireRedASR-LLM(8.3B參數(shù)量)在公開測試集上取得了3.05%的字錯誤率(CER),成為新的SOTA,相比此前的SOTA模型Seed-ASR(12B+參數(shù))降低了8.4%的錯誤率。

高效推理:FireRedASR-AED(1.1B參數(shù)量)在保持高準(zhǔn)確率的同時,顯著提升了推理效率,其CER為3.18%。

多場景適配:FireRedASR在短視頻、直播、語音輸入和智能助手等多種日常場景下表現(xiàn)出色,與業(yè)內(nèi)領(lǐng)先的ASR服務(wù)提供商和Paraformer-Large相比,CER相對降低23.7%~40.0%。

歌詞識別能力:在需要歌詞識別能力的場景中,F(xiàn)ireRedASR-LLM的CER實現(xiàn)了50.2%~66.7%的相對降低,展現(xiàn)了極強的適配能力。

多語言支持:FireRedASR支持普通話,在中文方言和英語語音識別方面表現(xiàn)出色,進一步拓寬了其應(yīng)用范圍。

FireRedASR模型兩個核心版本:

FireRedASR-LLM

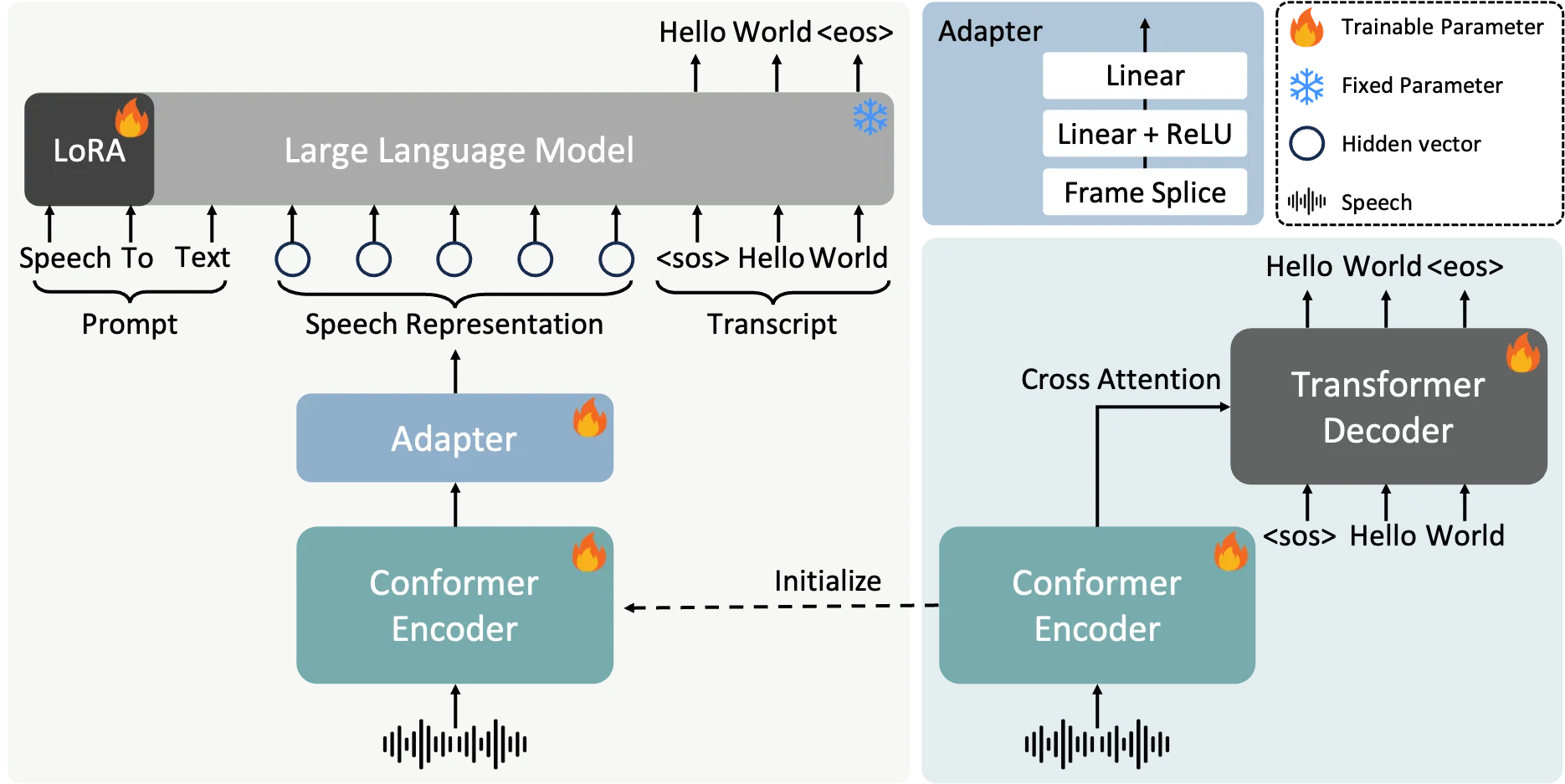

架構(gòu):采用Encoder-Adapter-LLM框架,結(jié)合大型語言模型Qwen2-7B-Instruct,通過LoRA微調(diào)實現(xiàn)端到端語音交互。

性能:在普通話基準(zhǔn)測試中CER為3.05%,相比前SOTA模型錯誤率降低8.4%;歌詞識別場景CER相對降低50.2%~66.7%。

特點:參數(shù)8.3B,專注極致精度,適合高要求場景如專業(yè)字幕生成。

FireRedASR-AED

架構(gòu):基于注意力編碼器-解碼器(Conformer編碼器+Transformer解碼器),參數(shù)1.1B。

性能:CER 3.18%,優(yōu)于12B參數(shù)的Seed-ASR,推理效率更高。

特點:平衡準(zhǔn)確率與計算效率,適合實時應(yīng)用如直播字幕、語音助手。

FireRedASR技術(shù)亮點:

多場景適配:在短視頻、直播等日常場景中,CER相對降低23.7%~40.0%;支持中文方言和英語。

開源生態(tài):模型與代碼已開源(GitHub),采用工業(yè)級設(shè)計,支持社區(qū)二次開發(fā)。

訓(xùn)練策略:LLM版本固定大部分參數(shù),僅訓(xùn)練編碼器和適配器,保留預(yù)訓(xùn)練能力。

FireRedASR的應(yīng)用場景

智能語音交互:FireRedASR可以應(yīng)用于智能語音助手、語音輸入法等場景,提供高精度的語音識別服務(wù)。

多媒體內(nèi)容理解:FireRedASR在視頻字幕生成、歌詞識別等多媒體內(nèi)容理解場景中表現(xiàn)出色。

日常場景應(yīng)用:FireRedASR在短視頻、直播、語音輸入和智能助手等多種日常場景下表現(xiàn)出色,與業(yè)內(nèi)領(lǐng)先的ASR服務(wù)提供商和Paraformer-Large相比,CER相對降低23.7%~40.0%。

FireRedASR相關(guān)鏈接:

項目地址:https://github.com/FireRedTeam/FireRedASR

論文地址:https://arxiv.org/abs/2501.14350

提交您的產(chǎn)品

提交您的產(chǎn)品  Ai應(yīng)用

Ai應(yīng)用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 開源AI應(yīng)用平臺

開源AI應(yīng)用平臺