DiffPortrait360:一種能夠從單張人物肖像圖像生成完整一致的360度頭部視圖的方法

DiffPortrait360是什么?

在游戲、電影和動畫制作中,CG角色是內容創作的核心,需要在真實感和風格化之間找到平衡。以往的多視圖立體系統和3D掃描儀常用于創建逼真的人類角色,但風格化角色仍需從頭開始建模。而DiffPortrait360的出現,為高效生成風格化角色提供了一種新的思路。

DiffPortrait360是一種3D頭部視圖生成技術,它能夠從單張人物肖像照片中生成360度的全方位頭部圖像。這項技術通過結合預訓練的潛在擴散模型和多個輔助模塊,實現了高質量、風格化的3D頭部視圖合成。DiffPortrait360支持多種復雜輸入,如不同發型、姿態和面部表情,生成的模型可以廣泛應用于沉浸式遠程交互、個性化內容創作以及游戲和動畫制作中。

方法原理

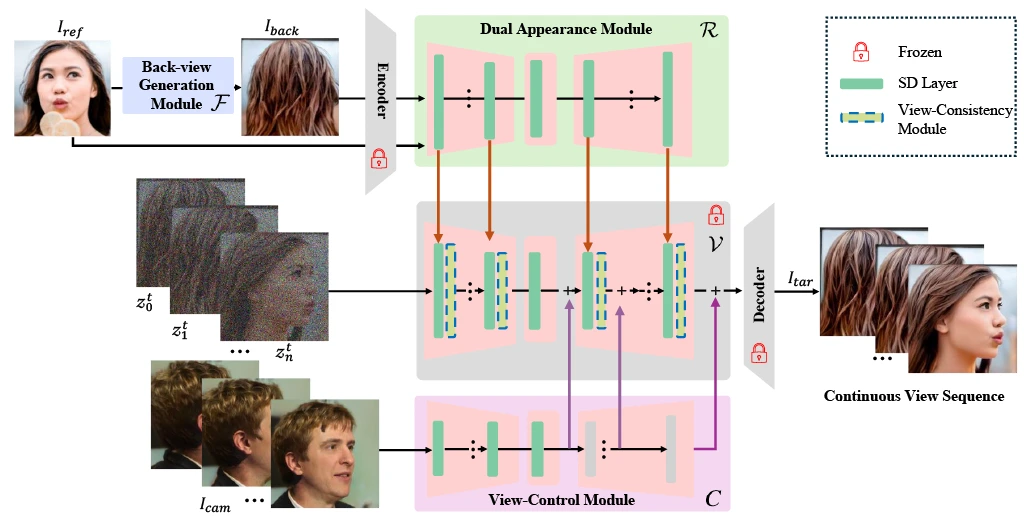

架構:DiffPortrait360以預訓練的潛在擴散模型(LDM)作為渲染骨干網絡,并引入了三個輔助可訓練模塊,分別用于控制雙外觀R、相機控制C和具有視圖一致性的U-Nets。其中,R從正面和背面圖像中提取外觀信息,C推導相機姿態并使用現成的3D GAN進行渲染。

關鍵創新:該方法基于DiffPortrait3D框架,加入了自定義的ControlNet用于生成后腦細節,以及雙外觀模塊以確保全局前后一致性。通過在連續視圖序列上進行訓練并整合后視圖參考圖像,實現了穩健的局部連續視圖合成。

訓練策略:采用連續采樣訓練策略,以更好地保持相機軌跡的連續性,并增強幀之間連續性的注意力,以保持外觀信息在旋轉角度變化時不變。

優勢與特點

應用廣:能夠生成人類、風格化以及擬人化形式的360度頭部視圖,比如配飾眼鏡和帽子。

質量高:可以生成高質量的神經輻射場(NeRFs),用于實時自由視點渲染,在對象合成和360度頭部生成方面優于現有的最先進方法。

魯棒性強:能夠處理各種復雜的輸入,包括復雜發型、不同頭部姿態、豐富的面部表情以及詳細的元素如舌頭等。

應用前景

沉浸式遠程存在應用:通過生成高質量的360度頭部視圖,為用戶提供真實的體驗。

個性化內容創作:能夠根據用戶提供的單張肖像圖像,快速生成具有不同視角的3D頭部模型。

游戲和動畫制作:可以高效地生成風格化的角色頭部模型,提高游戲和動畫制作的效率和質量。

Github地址:https://github.com/FreedomGu/DiffPortrait360

提交您的產品

提交您的產品  Ai應用

Ai應用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 開源AI應用平臺

開源AI應用平臺