阿里巴巴正式開源通義萬相Wan2.1視頻生成AI模型

Wan2.1是什么?

Wan2.1(通義萬相2.1)是阿里巴巴于2025年2月25日正式發布的一個全新的開源視頻生成模型,該ai模型基于Apache 2.0協議開源,提供了14B和1.3B兩個參數規格的推理代碼和權重,支持文生視頻和圖生視頻任務。性能有非常大的提升,在多個基準測試中超越了其他先進模型,包括Sora、HunyuanVideo、Minimax、Luma、Gen3、Pika等國內外視頻生成模型。

Wan2.1的功能:

中英文視頻生成:

Wan2.1是首個能夠生成中英文文本的視頻模型,具有強大的文本生成能力,能夠生成具有電影級效果的文字和動畫。

支持多種場景下的字體應用,包括特效字體、海報字體以及真實場景中的字體展示。

多任務支持:

提供文本到視頻(text-to-video)和圖像到視頻(image-to-video)生成。

支持視頻編輯、視頻到音頻等任務。

文本生成圖像(T2I):支持文本到圖像生成。

視頻生成音頻(V2A):可以為視頻自動生成匹配的音頻。

高質量性能:

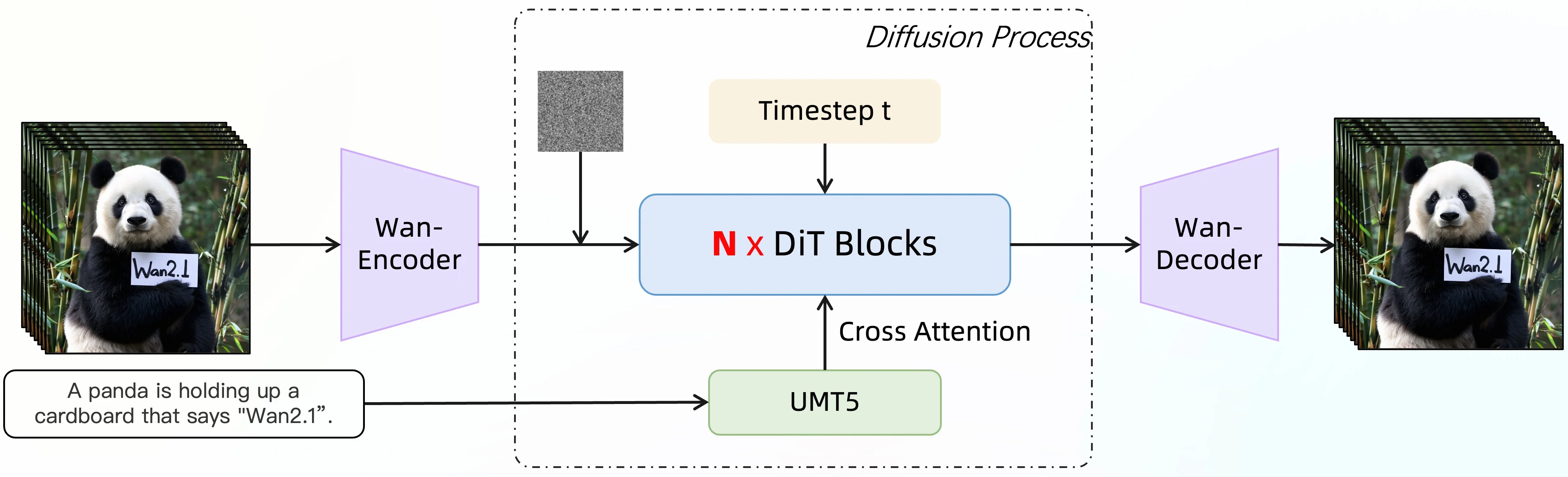

基于混合變分自編碼器(VAE)和擴散變換器(DiT)架構,增強了時間建模和場景理解能力。

能夠同時生成高清視頻、動態字幕和多語言配音,支持1080p分辨率和高效的編解碼。

消費級硬件支持:

1.3B版本的Wan2.1模型僅需8.19GB顯存即可運行,適用于RTX 4090顯卡,使得專業級視頻創作進入消費級硬件領域

風格多樣化:

支持多種藝術風格,如卡通、電影色、3D風格、油畫、古典等。

長視頻生成:

通過特征緩存機制,支持無限長1080P視頻的生成。

核心架構

混合變分自編碼器(VAE):用于視頻的編解碼,支持無損編解碼任意長度的1080P視頻流,同時保留時序信息。

擴散變換器(DiT):基于視頻的DiT結構,通過Full Attention機制確保長時程時空依賴的有效建模,實現時空一致的視頻生成。

Wan2.1的應用:

影視創作:快速打造復雜場景和特效,比如科幻片中的外星世界或宏大的戰爭場面,大幅降低制作成本和時間。

廣告營銷:根據品牌特點,定制創意廣告視頻,提升品牌曝光度和吸引力。

教育培訓:制作生動的教學視頻和動畫課件,幫助學生更直觀地理解知識點,豐富教學資源。

游戲娛樂:生成逼真的游戲場景和角色動畫,提升游戲畫面質感和玩家沉浸感。

短視頻與社交媒體:快速產出高質量短視頻,適合社交媒體傳播,輕松吸引更多觀眾。

虛擬角色與動畫制作:支持復雜角色動作和場景設計,適用于電影、廣告或游戲中的虛擬角色創作。

部署方式:

在線體驗:

提供了Hugging Face Spaces和ModelScope的在線體驗服務。

可通過阿里通義千問APP或網站訪問。

本地部署:

提供了詳細的本地部署步驟,適用于1.3B模型。

需要確保torch版本大于等于2.4.0,并安裝相關依賴。

使用Hugging Face CLI下載模型權重,并通過Gradio框架進行部署。

云端鏡像:

推薦使用Runninghub平臺在線體驗AI應用和工作流。

新注冊用戶可獲得免費額度,支持云端鏡像部署。

立即體驗:

模型權重:https://huggingface.co/Wan-AI/Wan2.1-I2V-14B-720P

在線體驗:https://modelscope.cn/studios/Wan-AI/Wan-2.1(建議使用版本)

ModelScope:https://modelscope.cn/organization/Wan-AI

Github:https://github.com/Wan-Video/Wan2.1

提交您的產品

提交您的產品  Ai應用

Ai應用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 開源AI應用平臺

開源AI應用平臺