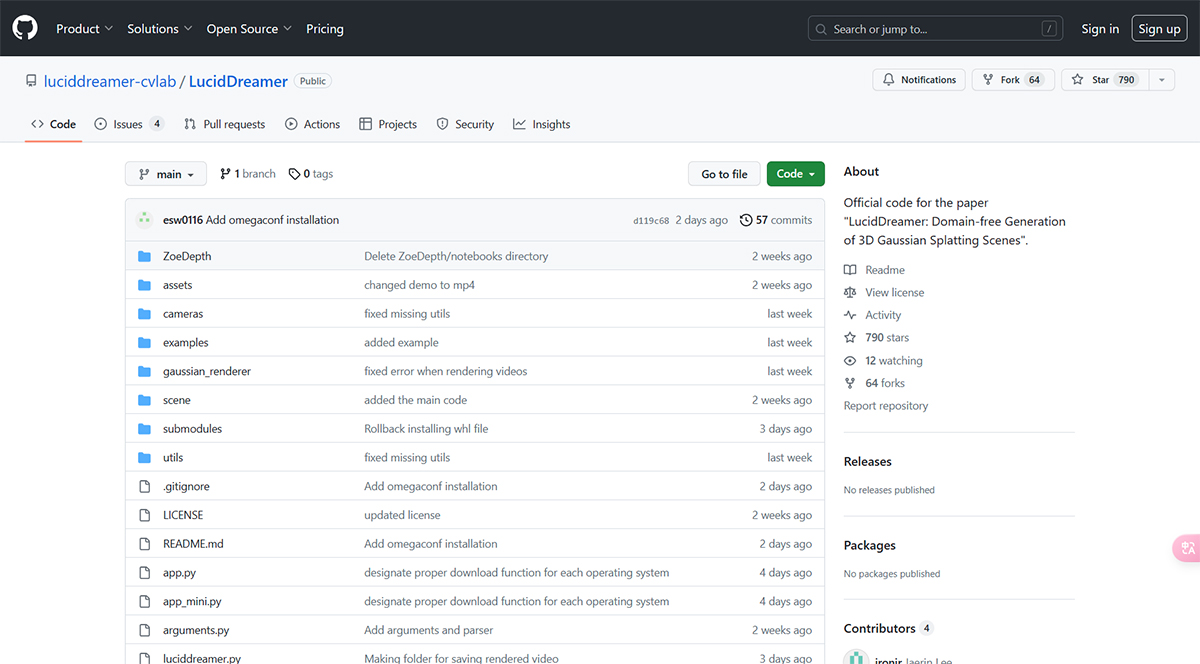

LucidDreamer

LucidDreamer簡介

隨著VR設備和內容的廣泛使用,對3D場景生成技術的需求越來越普遍。然而,現有的 3D 場景生成模型將目標場景限制在特定領域,這主要是因為它們使用的 3D 掃描數據集與現實世界相去甚遠。為了解決這種局限性,我們提出了LucidDreamer,這是一個無域場景生成管道,它充分利用了現有大規模基于擴散的生成模型的強大功能。

LucidDreamer項目地址:https://luciddreamer-cvlab.github.io/

我們的 LucidDreamer 有兩個交替步驟:做夢和對齊。

首先,為了從輸入生成多視圖一致的圖像,我們將點云設置為每次生成圖像的幾何參考。具體來說,我們將一部分點云投影到所需的視圖,并提供投影作為使用生成模型進行修復的指導。使用估計的深度圖將繪制的圖像提升到 3D 空間,從而組成一個新點。

其次,為了將新點聚合到3D場景中,我們提出了一種對齊算法,該算法將新生成的3D場景的各個部分和諧地集成在一起。最終得到的3D場景是優化高斯飛濺的初始點。與以前的 3D 場景生成方法相比,LucidDreamer 生成的高斯飛濺非常詳細,對目標場景的域沒有限制。

LucidDreamer 可以接受一系列文本提示來生成場景,從而實現細粒度的控制。

基于 CLIP 的 Stable Diffusion 生成的圖像對生成的場景進行定量比較。 我們使用 CLIP-Score 和 CLIP-IQA 與 RGBD2 對結果進行定量比較。 對于 CLIP-IQA,我們使用質量、色彩鮮艷和清晰的標準。 LucidDreamer 在所有指標上都顯示出占主導地位的結果。

根據初始SfM點的來源重建高斯飛濺的度量。我們使用 COLMAP并比較重建結果。使用我們的點云始終如一地顯示出更好的重建指標。

提交您的產品

提交您的產品  Ai應用

Ai應用 Ai資訊

Ai資訊 AI生圖

AI生圖 AI生視頻

AI生視頻 開源AI應用平臺

開源AI應用平臺